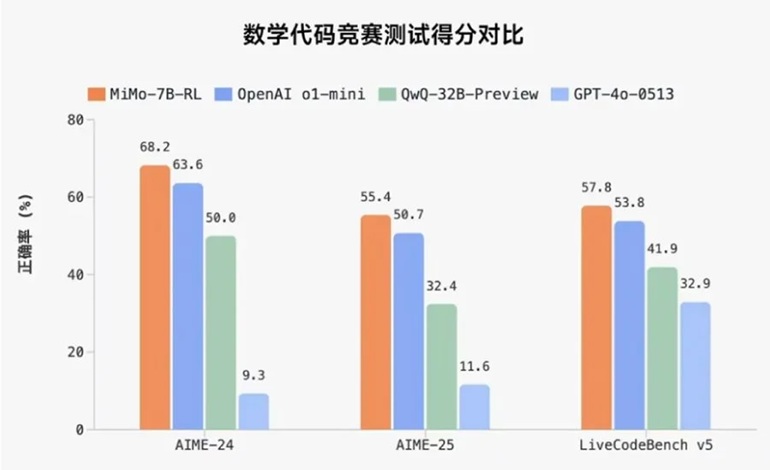

شیائومی بهطور رسمی وارد حوزه مدلهای زبانی بزرگ (LLM) شده و مدل MiMo-7B را بهعنوان اولین سیستم هوش مصنوعی متنباز خود معرفی کرده است. این مدل که توسط تیم جدید Big Model Core توسعه یافته، بهطور ویژه برای انجام وظایف پیچیده استدلالی طراحی شده و در زمینههای استدلال ریاضی و تولید کد عملکرد بهتری نسبت به مدلهای OpenAI و Alibaba دارد.

ویژگیهای کلیدی MiMo-7B MiMo-7B یک مدل با 7 میلیارد پارامتر است که با وجود اندازه کوچکتر نسبت به بسیاری از مدلهای پیشرفته، عملکردی قابلمقایسه با سیستمهای بزرگتر مانند o1-mini از OpenAI و Qwen-32B-Preview از Alibaba دارد.

شیائومی برای آموزش این مدل، 200 میلیارد داده مرتبط با استدلال را جمعآوری کرده و در سه مرحله آموزشی، 25 تریلیون داده را به مدل تزریق کرده است. همچنین، بهجای روش استاندارد پیشبینی توکن بعدی، از هدف پیشبینی چندتوکنی استفاده کرده که زمان استنتاج را کاهش داده و کیفیت خروجی را حفظ میکند. نسخههای منتشر شده شیائومی چهار نسخه از MiMo-7B را منتشر کرده است:

- Base: مدل خام و پیشتمرینشده

- SFT: نسخهای که با دادههای نظارتی بهینهسازی شده است

- RL-Zero: مدل تقویتشده از نسخه پایه

- RL: نسخه نهایی که بر اساس مدل SFT ساخته شده و بالاترین دقت را ارائه میدهد

این مدل اکنون بهصورت متنباز در Hugging Face در دسترس است و مستندات و نقاط بررسی آن نیز در GitHub منتشر شدهاند.