آنتروپیک روز پنجشنبه محصول جدیدی به نام Claude Gov معرفی کرد که به طور خاص برای آژانسهای دفاعی و اطلاعاتی آمریکا طراحی شده است. این مدلهای هوش مصنوعی دارای محدودیتهای کمتری برای استفادههای دولتی بوده و توانایی تحلیل اطلاعات طبقهبندیشده را دارند.

این شرکت اعلام کرده است که مدلهای Claude Gov هماکنون توسط آژانسهایی در بالاترین سطح امنیت ملی ایالات متحده استفاده میشوند و دسترسی به آنها محدود به نهادهای دولتیای خواهد بود که با اطلاعات محرمانه سروکار دارند. Anthropic مشخص نکرده که این مدلها از چه زمانی مورد استفاده قرار گرفتهاند.

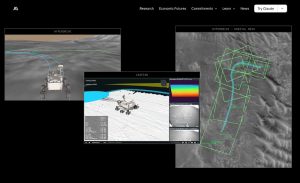

Claude Gov برای نیازهای خاص دولت، از جمله ارزیابی تهدیدها و تحلیل اطلاعات، طراحی شده است. این مدلها همچنین توانایی بالاتری در درک اسناد و زمینههای مرتبط با دفاع و اطلاعات دارند و میتوانند زبانها و گویشهای مرتبط با امنیت ملی را بهتر پردازش کنند.

استفاده از هوش مصنوعی در نهادهای دولتی مدتهاست که به دلیل پیامدهای احتمالی منفی، به ویژه برای اقلیتها و جوامع آسیبپذیر، مورد بررسی و انتقاد قرار گرفته است. از نمونههای مشکلات پیشآمده میتوان به بازداشتهای اشتباه ناشی از استفاده پلیس از فناوری تشخیص چهره، تبعیض در الگوریتمهای دولتی، و تأثیرات فناوری بر حوزههای مختلف اشاره کرد.

Anthropic در سیاستهای استفاده از محصولات خود محدودیتهایی، از جمله ممنوعیت ایجاد یا تسهیل تبادل سلاحهای غیرقانونی یا تحت کنترل شدید اعمال کرده است. این شرکت اعلام کرده که برخی استثناهای قراردادی را برای آژانسهای دولتی منتخب ایجاد کرده است، اما همچنان ممنوعیتهایی مانند کمپینهای انتشار اطلاعات نادرست، طراحی یا استفاده از سلاحها، ساخت سیستمهای سانسور، و عملیات سایبری مخرب پابرجا خواهند ماند.

Claude Gov پاسخی به محصول مشابه OpenAI با نام ChatGPT Gov است که در ماه ژانویه معرفی شد. این روند نشاندهنده علاقه شرکتهای هوش مصنوعی به همکاری با نهادهای دولتی، به ویژه در شرایط نامشخص قانونگذاری، محسوب میشود.